Ilustration: François Berger

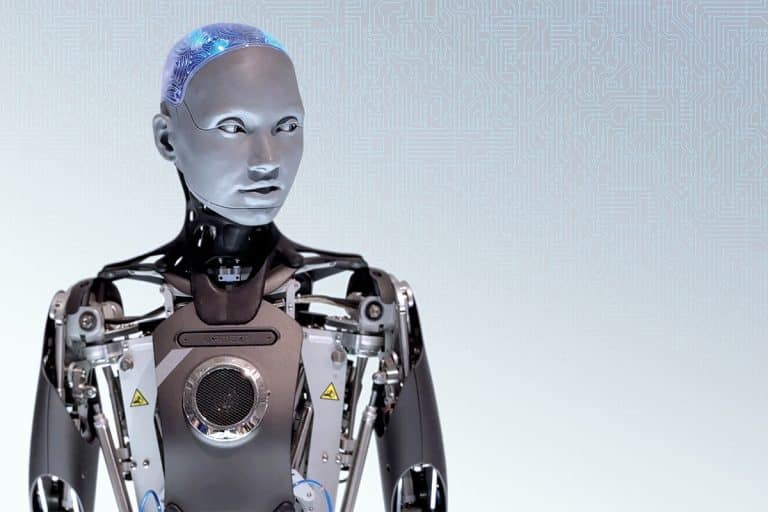

Les assistants vocaux tels que Siri et Alexa s’améliorent constamment. Auront-ils un jour une conversation réellement intéressante?

«Siri, appelle au bureau. » Il suffit de quelques mots énoncés à voix haute pour qu’un assistant virtuel vous obéisse, qu’il s’agisse de faire jouer votre liste d’écoute favorite ou de vous renseigner sur la météo du lendemain. Mais n’ouvrez pas votre cœur à ces agents toujours fidèles au poste sur votre téléphone ou haut-parleur intelligent. Cela risque de se corser, comme l’a découvert une équipe de l’Institut québécois d’intelligence artificielle (Mila) qui figurait parmi les finalistes du premier concours Alexa Prize en 2017 .

Alexa est l’assistant vocal personnel d’Amazon. La compagnie tente depuis trois ans d’améliorer ses aptitudes oratoires par l’entremise d’une compétition entre scientifiques. Et c’est du sérieux ! Après plusieurs mois de travail, le robot virtuel de chaque équipe interagit avec un humain sous l’oreille attentive de plusieurs juges. Celui qui sera capable de soutenir une conversation cohérente de 20 minutes sur une panoplie de sujets fera gagner à son équipe une cagnotte de un million de dollars américains. Signe que ce défi n’est pas à la portée de tous, aucune n’a encore réussi l’exploit.

Iulian Serban, un membre de l’équipe montréalaise, raconte l’histoire d’une volontaire ayant testé le système de 2017 de l’équipe.